GLM-5.1からQwen3.6へ 中国モデルのオープン化はなぜ遅くなっているのか

GLM-5.1、MiniMax M2.7、Qwen3.6-Plus の公式発表とコミュニティの反応をもとに、中国モデル企業が API を先に出し、重み公開を後ろにずらし始めている理由を考察します。

更新日: 2026年4月12日

この1年、中国のAIモデル業界で目立っていた流れのひとつは、とても分かりやすいものでした。ブログが公開されると、その直後に重みも出てくる。Qwen、DeepSeek、Kimi、GLM、StepFun が次々に期待値を更新し、開発者のあいだでは 「中国ベンダーは今後もフラッグシップ級の open-weight モデルを積極的に出し続ける」 という見方がかなり強くなっていました。

ですが、2026年の春に入って、そのリズムに少し変化が見え始めました。

GLM-5.1、MiniMax M2.7、Qwen3.6-Plus の3つを並べて見ると、この変化はかなりはっきりします。どれも agentic coding、長時間タスク、実運用ワークフローでの性能を強く打ち出していますし、中国企業が依然として最前線で戦えていることも示しています。けれど同時に、別の事実も見えてきます。フラッグシップモデルの発表日と、open-weight の公開日が、以前ほど一致しなくなってきた ということです。

いま増えているのは、だいたい次のような流れです。

- まず API、Coding Plan、あるいはホスト型サービスを先に出す。

- 実運用での安定性、価格、商用需要を見ながら様子を見る。

- その後で、重みを公開するか、どのサイズまで公開するか、どこまで緩いライセンスにするかを決める。

これは「中国企業がもうモデルを開かなくなった」という意味ではありません。ただ、オープン公開が“発表と同時にやる標準動作”から、“段階的に判断するプロダクト戦略”へと変わりつつある のは確かです。

より広い業界の背景から見たいなら、以前にまとめた 中国LLMの現状観測 を先に読むと流れをつかみやすいです。中国以外の open model 戦略も比較したいなら、Gemma 4 オープンモデルガイド も参考になります。

1. GLM-5.1: もっとも「従来型のオープンモデル成功例」に近い

この3つの中で、GLM-5.1 はいちばん「開発者がこれまで見慣れてきた open model の物語」に近い存在です。

Hugging Face 上の GLM-5.1 のモデルカード では、ライセンスは MIT と明記されており、「agentic engineering に向けた次世代フラッグシップモデル」と位置づけられています。ここで重要なのは、単に最初の回答が強いという話ではないことです。モデルカードが強調しているのは、長時間の agent タスクの中で、問題を分解し、ツールを呼び出し、結果を読み取り、方針を修正しながら、数百ステップにわたって有効性を保てるかどうか、という点です。

この打ち出し方はかなり重要です。2025年までの「誰がより人間っぽく話せるか」「1ターンの推論デモで強く見えるか」という勝負とは、焦点が明らかに違います。GLM-5.1 が売りにしているのは、実際のエンジニアリングの流れにモデルを入れたとき、数ターンで失速せず、長く使い続けられるか という価値です。

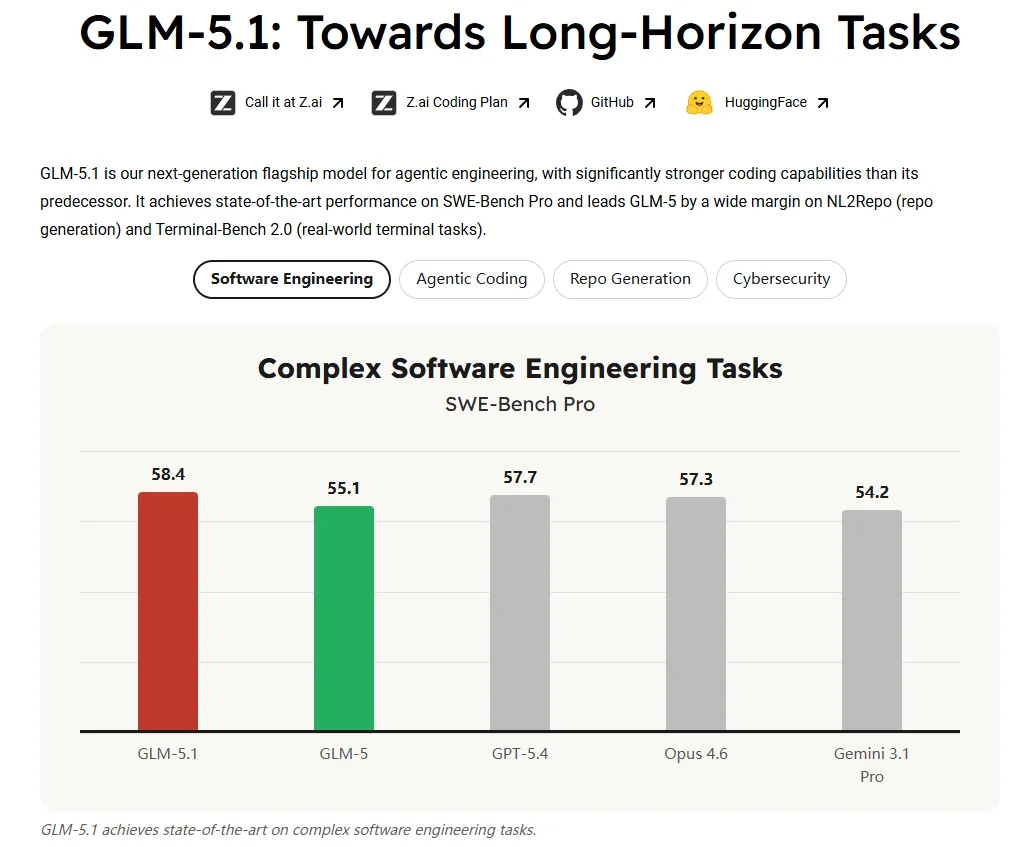

Z.ai が公開している benchmark も、その方向性にかなり沿っています。Hugging Face のモデルカードには SWE-Bench Pro 58.4、NL2Repo 42.7、Terminal-Bench 2.0 63.5 といった数値が並び、比較対象として Qwen3.6-Plus、MiniMax M2.7、Claude Opus 4.6、Gemini 3.1 Pro、GPT-5.4 が直接置かれています。ここから読み取れるのは、Z.ai が GLM-5.1 を「安い代替品」として売ろうとしているのではなく、トップ層の agent / coding モデルと同じ土俵にいる と訴えていることです。

コミュニティの反応も、だいたいこの方向に沿っています。

- r/LocalLLaMA のスレッド では、

GLM-5.1が OpenClaw 系の agent benchmark で Opus 4.6 にかなり近い、という評価が出ていました。 - ローカル実行寄りの別スレッドでも、話題の中心は単発のスコアではなく、長い tool call の連鎖でどれだけ安定して動くかでした。つまりコミュニティの関心も、派手な数値より実際の agent harness 上の挙動へ移ってきています。ソース

- もちろん懐疑的な声もあります。Hugging Face の Discussions では、

100Ktoken を超えるあたりで性能が落ちるという報告や、長文脈・ブラウジング系 benchmark の再現性に疑問を投げる声も出ています。ソース 1 ソース 2

つまり GLM-5.1 が示しているのは、「open model がノーコストで closed model に追いついた」という話ではありません。もっと現実的な状態です。agentic coding では open-weight モデルが本当に前列に入ってきたが、モデルは依然として巨大で、うまく回すコストも高く、長文脈の安定性もまだ議論の余地がある ということです。

だからこそ、私は GLM-5.1 をこの話の基準サンプルだと見ています。中国ベンダーはまだフラッグシップ級の公開をやめていません。ただし、その中でも比較的オープン寄りなケースですら、物語はすでに「誰でもローカルで回せる」から「重みは手に入るし、その上にエコシステムも作れるが、高品質に使うには相応のハードルがある」へ移りつつあります。

2. MiniMax M2.7: 性能は強いが、ライセンスが議論の中心になった

GLM-5.1 が「フラッグシップの open-weight にはまだ戦略的価値がある」という立場を表しているなら、MiniMax M2.7 はもう少し慎重な道を示しています。重みは公開するが、商用レイヤーの主導権は強く握る という方向です。

MiniMax は 2026年3月18日の公式ブログ で、M2.7 を「自らの進化に深く参加する最初のモデル」と説明しています。この打ち出しはかなり強気です。単にコードが書けるだけではなく、複雑な agent harness を組み、memory を持ち、複雑な skills を使い、強化学習の実験に関わり、さらには次の学習・評価サイクルの改善にも役立つ、という描き方です。

ブログ内の benchmark も、汎用チャット品質より実ワークフロー寄りです。

SWE-Pro 56.22%VIBE-Pro 55.6%Terminal Bench 2 57.0%GDPval-AA ELO 1495MLE Bench Liteの24時間自律実行を3回行った平均 medal rate は66.6%

こうした指標が支えている中心メッセージは明快です。MiniMax は M2.7 を「少し強いテキストモデル」ではなく、「自己改善できるワークエージェント」として見せたい のです。

この訴求は、少なくとも最初はかなり刺さっていました。

- r/LocalLLaMA の発表スレッド では、単体の benchmark よりも、モデルが自分の反復改善と評価ループに参加するという話そのものに興味を持つ人が多く見られました。

- PinchBench / Kilo Bench の実測投稿 でも、

M2.7は見かけの速さを優先するチャットモデルというより、難しいタスク向けに調整された agent モデルに見える、という好意的な評価が出ています。

ただし、MiniMax M2.7 をめぐる空気はすぐに変わりました。「強そうだ」という話から、「これは本当に open source と呼べるのか」という話へ移ったのです。

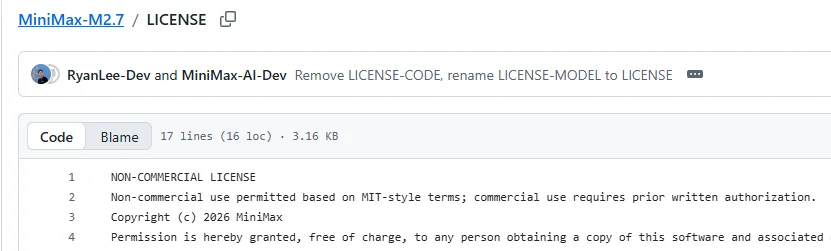

2026年4月12日時点 で、Hugging Face 上の MiniMax-M2.7 リポジトリ は公開されていますが、表示されているライセンスは一般的な MIT や Apache-2.0 ではなく modified-mit です。さらに実際の LICENSE ファイル を見ると、意味はかなりはっきりしています。非商用利用は MIT に近い形で認めるが、商用利用には事前の書面承認が必要 という内容です。

これによって、この公開の意味合いはかなり変わってきます。

多くの開発者にとって本当に大事なのは、「重みをダウンロードできるか」だけではないからです。むしろ気になるのは次の点です。

- 自分のプロダクトに組み込めるのか

- 商用環境で fine-tune、ホスト、デプロイできるのか

- 長期的に保守できる技術スタックの土台にできるのか

そのため、Hugging Face の Discussions ではライセンスに対する疑問がすぐに集まりました。“No commercial use allowed in License?” というスレッドでも、要点はとてもシンプルです。商用利用が強く制限されるなら、これは開発者が普段考える「オープンモデル」というより、ダウンロード可能な評価版に近いのではないか、ということです。

M2.7 が示している重要な点はそこにあります。ある意味では開いている。しかし同時に、別の流れもはっきり示しています。ベンダーは重みを公開しても、もっとも商業価値の高い部分を以前のように自由には手放さなくなってきている のです。

3. Qwen3.6-Plus: もっとも分かりやすい「API先行、公開は後」のケース

オープン化のスピード低下をもっとも象徴的に示す例をひとつ挙げるなら、現時点では Qwen3.6-Plus だと思います。

Alibaba は 2026年4月1日の公式ブログ で、Qwen3.6-Plus を実世界エージェント向けの新しいフラッグシップとして位置づけ、次のようなポイントを強く打ち出しました。

- デフォルトで

1M context window - 大きく強化された

agentic coding - より強いマルチモーダル認識と推論

- API で即時利用可能

そして記事の終盤には、とても重要な一文があります。“In the coming days, we will also open-source smaller-scale variants.” です。これは「公開しない」と言っているわけではありません。ただ、今回の順番が明確に変わったことを示しています。まずホスト型の旗艦モデルを出し、その後で小さい open variant を出す、という順番です。

この変化だけでも、コミュニティの空気を変えるには十分でした。

Qwen はこれまで、グローバルな開発者から見て「中国発の open model ブランドの中でもかなり信頼できる存在」という位置を築いていました。期待されていたのは、単に Qwen が進化し続けることではありません。強いバージョンが、これまでのように比較的早く open-weight でも出てくること でした。その期待が崩れると、たとえ一時的であっても、コミュニティはすぐにそれを戦略の変化として受け取ります。

議論の内容にも、その変化がかなりはっきり表れています。

- Qwen3.6-Plus の LocalLLaMA スレッド では、実際の coding workflow で強く感じるという声があり、失敗したプランから立て直して方針転換する能力を評価するコメントも見られました。

- その一方で、同じスレッドには「なぜ今回は初日から open-weight ではないのか」「小さい variants はいつ来るのか」「Qwen は open model の旗手から API-first の商用プロダクトへ寄っているのではないか」といった声も多くあります。

- さらに Is Qwen 3.6 going to be open weights? という別スレッドを見ても、関心の中心がすでに「重みはいつ出るのか」に移っていることが分かります。

もっと重要なのは、2026年4月12日時点 で、Qwen の公式 Hugging Face 組織配下に Qwen3.6 あるいは Qwen3.6-Plus の公式 weight リポジトリをまだ確認できなかったことです。ここは慎重に書いておきたい点ですが、これは Alibaba が明確に「出さない」と言ったという意味ではありません。ただ、公開情報として検証できる範囲では、4月1日の発表から4月12日まで、コミュニティは依然として待っている状態だった ということです。

だからこそ Qwen3.6-Plus は、単に「また強いモデルが出た」というだけでは終わりません。フラッグシップ層では、Qwen ですら“即時の重み公開”より“プロダクトとしての先行展開”を優先し始めている ことを示す、分かりやすい分岐点になっています。

4. なぜこうなっているのか 私は4つの理由が大きいと思う

ここは先に断っておきたいのですが、この章は各社が公式に同じ説明をしているわけではありません。公開タイミング、ライセンス設計、コミュニティ反応を見たうえでの、私なりの整理です。

1. agent モデルの価値は、重み単体ではなくワークフロー側に移っている

2024年は、まだ単発の回答品質で競う場面が多くありました。ですが2026年になると、本当に問われているのは次のような点です。

- ターミナルで何時間も作業を続けられるか

- ツールを安定して使えるか

- memory を維持できるか

- repo レベルのタスクで収束し続けられるか

こうなると、モデルの価値は重みそのものだけにあるわけではありません。価値の重心は、次のような周辺要素にも大きく移ります。

- scaffolds

- harnesses

- prompt engineering

- skills や MCP のエコシステム

- 本番環境でのレート制御、キャッシュ、コスト最適化

だからこそ、ベンダーにとっては API やホスト型の作業環境を先に出す方が自然です。その方が製品として完成度が高く、制御もしやすく、収益化もしやすいからです。

2. フラッグシップモデルは高コストなので、まずホスト型で回収するのが現実的

GLM-5.1 のような 700B 超クラスでも、MiniMax M2.7 のような巨大 MoE でも、本当に質の高い運用は「重みを落として終わり」ではありません。推論用ハードウェア、長文脈処理、同時実行、キャッシュ、ツール利用のコストはすぐに膨らみます。

そう考えると、最強版をまず API の内側に置くのは、開放性への裏切りというより、かなり素朴なビジネス上の現実です。

3. 各社は「全開放」ではなく「段階的な開放」を選び始めている

MiniMax M2.7 のライセンスは、その典型例です。完全に閉じているわけでもなければ、完全に開いているわけでもありません。メッセージとしてはだいたい次の通りです。

- 重みはダウンロードできる

- 非商用なら試せる

- 商用利用には追加の許可が必要

つまり、コミュニティ拡散のメリットは取り込みたいが、商用コントロールまでは一気に手放したくない、という中間的な立場を取る企業が増えているように見えます。

4. コミュニティの「オープン」の定義が、企業の宣伝文句より厳しくなった

以前は、重みがダウンロードできれば open source と呼んでしまう企業も多くありました。いまは開発者側がそれをそのまま受け入れなくなっています。すぐに次のような問いが返ってきます。

- OSI 的な意味で open source なのか

- 商用利用に制限はあるのか

- fine-tune、蒸留、ホスティング、再配布に制限はあるのか

- ライセンスが下流のコンプライアンス問題にならないか

つまり、いま起きている摩擦は「開いているかどうか」だけの話ではありません。インフラとして信頼されるには、どこまで開いていなければならないのか が問われているわけです。

5. これは開発者にとって何を意味するのか

開発者、チームリード、あるいは open model を継続的に追っている人にとって、この変化から読み取れる実務的なポイントは少なくとも3つあります。

第一に、もう「公式ブログ公開日 = 重み公開日」とは考えない方がいい ということです。この2つは今後ますますズレやすくなり、数日ではなく数週間、場合によってはそれ以上ずれる可能性もあります。

第二に、モデル評価ではライセンスを独立した重要項目として見るべき です。重みが落とせるからといって、安心して商用利用できるとは限りません。modified-mit のような表記は一見なじみがあっても、実際の制約はかなり重い場合があります。

第三に、本当に大事なのは「開いているか」だけではなく、開発者エコシステムに長く積み上げられるものを残しているかどうか です。多くのチームにとって必要なのは、世界最強モデルへの一時的なアクセスではなく、商用利用できて、fine-tune できて、デプロイできて、長期保守できる基盤です。

この視点で見ると、GLM-5.1、MiniMax M2.7、Qwen3.6-Plus の違いは、性能差だけではありません。開発者エコシステムに対して、どんな“開き方”をしているのかがかなり違います。

GLM-5.1は「フラッグシップでも可能な限り開く」という姿勢に見えるMiniMax M2.7は「重みは開くが、商用境界は厳しくする」という姿勢に見えるQwen3.6-Plusは「まず API に最強版を置き、公開はプロダクト展開の後に続ける」という姿勢に見える

FAQ

中国のモデル企業は、もうモデルを開かなくなったのか

いいえ。より正確に言うなら、最前線のフラッグシップモデルでは、発表タイミングと open-weight 公開タイミングが切り離されつつある ということです。引き続き公開されるモデルもあれば、後から公開されるモデルもあり、商用条件を厳しくしたうえで公開されるケースもあります。

Qwen3.6-Plus は今後も公開されないのか

そこまで断定するのは早いです。Qwen は 2026年4月1日 の公式ブログで、今後数日のうちに小さい variants を open-source 化すると明記しています。より慎重に言うなら、2026年4月12日時点では、公開情報として確認できる公式 weight リポジトリはまだ出ておらず、コミュニティは待っている状態だった ということです。

MiniMax M2.7 は本当の意味でオープンモデルと言えるのか

どの基準を採るかで答えは変わります。「重みがダウンロードできるか」だけを見るなら、ある意味ではオープンです。ただし、OSI 的な openness、制限のない商用利用、下流での互換性まで重視するなら、M2.7 は MIT や Apache-2.0 より明らかに保守的です。

まとめ

モデル性能だけを見れば、中国ベンダーはまったく失速していません。むしろ GLM-5.1、MiniMax M2.7、Qwen3.6-Plus を見ると、競争の中心はすでにチャットボットを超えて、実際の agent ワークフローへ移っています。

変わったのは、モデルが強くなっているかどうかではありません。最強クラスのモデルとオープンコミュニティの距離が、また少し開き始めている のです。

私はこれを、単純な閉鎖化ではなく「段階的オープン戦略」と捉えています。ただし開発者にとっては、それでも十分に注目すべき変化です。もし今後さらに多くのフラッグシップモデルが API-first、license-later、weights-when-stable という形を取るなら、2025年に中国ベンダーがグローバルな open model コミュニティの中で築いた強い信頼は、これまでのように自動的には維持されないかもしれません。

関連リンク

- GLM-5.1 Hugging Face モデルカード

- MiniMax M2.7 公式ブログ

- MiniMax M2.7 Hugging Face ページ

- MiniMax M2.7 LICENSE

- Qwen3.6-Plus 公式ブログ

- LocalLLaMA: Qwen3.6-Plus

- LocalLLaMA: Is Qwen 3.6 going to be open weights?

- LocalLLaMA: MiniMax-M2.7 Announced!

- LocalLLaMA: Benchmarked MiniMax M2.7

- LocalLLaMA: GLM 5.1

- LocalLLaMA: GLM 5.1 crushes every other model except Opus in agentic benchmark

出典について

この記事は merchmindai.net に掲載された内容です。共有または転載する場合は、出典と元記事のリンクを明記してください。

元記事リンク:https://merchmindai.net/blog/ja/post/glm-5-1-minimax-m2-7-open-model-shift