智谱AI GLM-4.5モデル概要

本稿は智谱AIが最新リリースしたGLM-4.5モデルの資料整理および紹介を目的とし、開発者に客観的かつ適時な技術リファレンスを提供します。

はじめに

最近、中国におけるオープンソース大規模モデルの爆発的な発展期と言えます。Kimi による K2、qwen による qwen3-coder のリリースに続き、中国の名高い企業智谱 AI(Zhipu AI)が GLM-4.5 モデルを公開しました。これに対し、open で始まるある大規模モデル企業のオープンソースモデルはまだ登場していません。

2025 年 7 月 28 日、オープンソース AI 基盤モデル分野において重要なアップデートがあり、智谱 AI(Zhipu AI)は最新の GLM-4.5 シリーズモデルを発表しました。本シリーズは技術革新によって、高性能かつ高効率なオープンソースソリューションを開発者コミュニティに提供することを目的としています。本稿では公開された技術資料と評価データをもとに、GLM-4.5 シリーズのコア特徴と性能について整理・分析します。

本文

1. モデルアーキテクチャとパラメータ

GLM-4.5 シリーズは 2 つのコアモデルを含み、どちらも Mixture of Experts(MoE)アーキテクチャを採用し、モデル規模と計算効率のバランスを図っています。

| モデル | 総パラメータ数 | 活性パラメータ数 | 主な特徴 |

|---|---|---|---|

| GLM-4.5 | 3550 億 (355B) | 320 億 (32B) | トップパフォーマンス、高度な推論&エージェントタスク向け |

| GLM-4.5-Air | 1060 億 (106B) | 120 億 (12B) | 高効率かつコンパクト(MoE アーキテクチャ)、主流消費者向けハードウェア対応 |

MoE アーキテクチャは推論時に一部のエキスパート(パラメータ)だけを活性化することで、大規模なパラメータによる強力な能力を維持しつつ、実際の計算負荷を著しく軽減します。特に GLM-4.5-Air は 12B の活性パラメータ設計で、32〜64GB のメモリを持つ消費者向け GPU 上での動作を実現し、量子化技術によって更にハードルを下げ、高性能大規模モデルが個人開発者や研究者にも普及しています。

中国の deepseek 社が MoE を用いた v3 および R1 モデルを公開して商用大モデルと肩を並べる性能を得た後、より多くの企業が MoE アーキテクチャで自社モデルをリリースし始めています。

2. ハイブリッド推論モード (Hybrid Reasoning)

GLM-4.5 シリーズは革新的な「ハイブリッド推論」フレームワークを導入し、単一モデル内に 2 種類の動作モードを統合しています:

- Thinking Mode(思考モード):複雑なタスク処理に特化し、多段階推論、ツール呼び出し、長期計画、自律エージェント機能をサポートします。このモードでモデルはタスクを自律的に分解し複雑な認知ワークフローを実行可能です。

- Non-Thinking Mode(非思考モード):即時かつ状態を持たない応答向けに最適化され、会話や高速な質問応答など低遅延のインタラクティブな場面に適しており、非常に高速な応答速度を提供します。

この二重モード設計により、モデルは用途に応じて柔軟に適応でき、開発者は強力な推論能力と高いインタラクティブ性の間で妥協する必要がありません。

3. パフォーマンス評価とベンチマーク結果

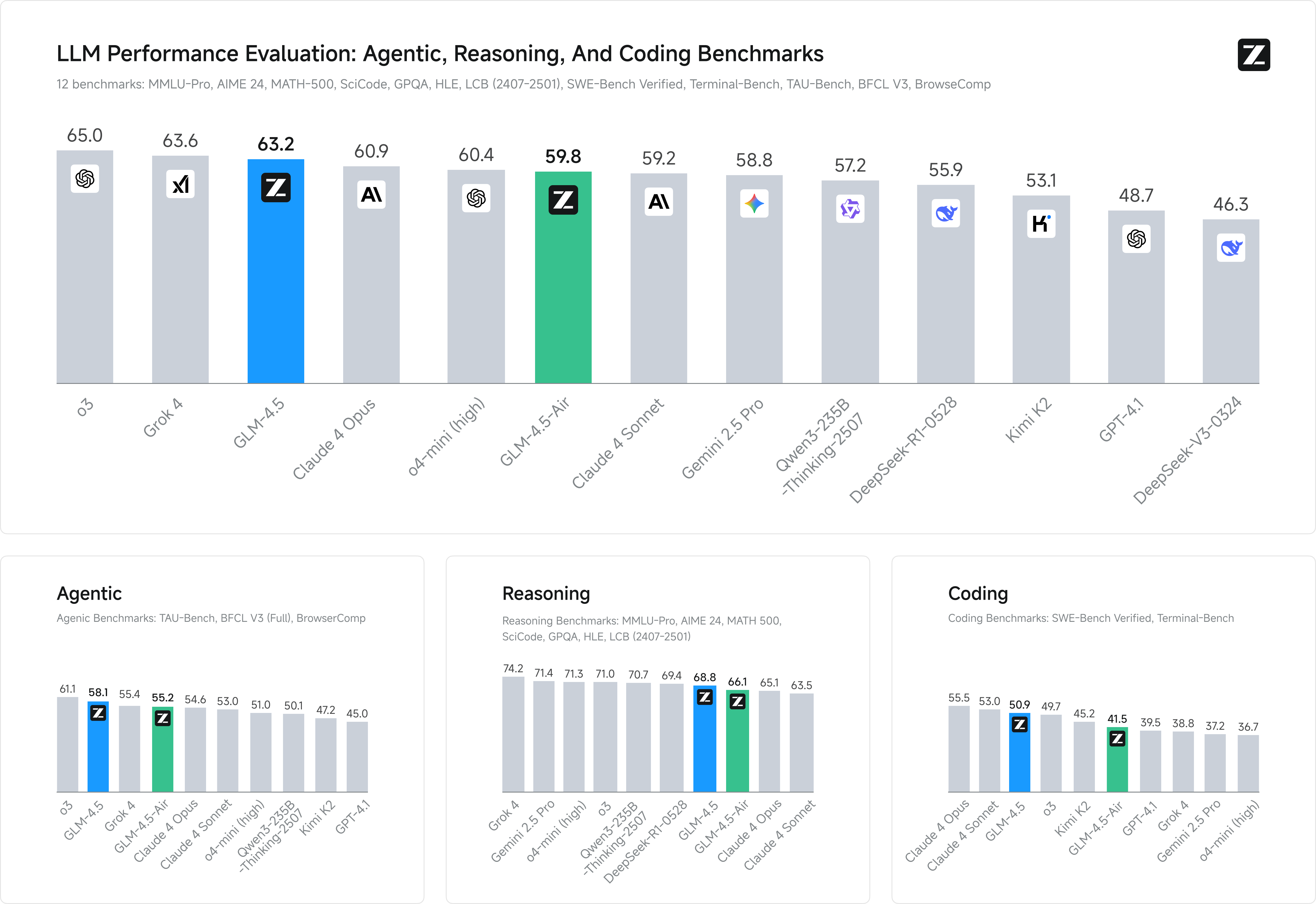

Z.ai が公開したデータによれば、GLM-4.5 シリーズは MMLU、GSM8K、HumanEval など 12 の業界標準ベンチマークで優れた結果を示しています:

- GLM-4.5:平均スコアは63.2で、全世界のモデル中 3 位、オープンソースモデルでは 1 位。

- GLM-4.5-Air:平均スコアは59.8で、百億パラメータ規模のモデルでリーダー的存在。

また特定能力では、GLM-4.5 シリーズは以下の点でも卓越しています:

- コード能力:SWE-bench Verified 評価でスコア64.2、GPT-4.1 や DeepSeek を上回る。

- コンテキストウィンドウ:最大128kの入力コンテキストと96kの出力コンテキストをサポートし、長文処理や複雑なプログラミングタスクに適応。

4. ネイティブエージェント能力 (Agent-Native Design)

GLM-4.5 は推論・計画・行動などエージェントコア機能をモデルアーキテクチャに組み込み、「ネイティブエージェント」能力を実現。これによりモデルは:

- 多段階タスク分解と計画を自主的に行う。

- 外部ツール・API をシームレスに統合・呼び出す。

- 複雑なワークフローやデータ可視化タスクを管理する。

- “感知―行動”の完全サイクルをサポートする。

この設計パラダイムはエージェントアプリケーションの開発プロセスを簡素化し、外部スケジューリングやプロセス制御コードへの依存を減らし、ビジネスロジックの実装に集中できるようにします。

5. 効率、速度、オープンネス

GLM-4.5 シリーズは推論効率とオープンネスでも新たな基準を打ち立てています:

- 推論速度:多 Token 予測(MTP)や推測デコード(Speculative Decoding)などの技術を駆使し、高性能 API の生成速度は100 tokens/secを超え、最大で200 tokens/secに達し、前モデル比で 2.5〜8 倍高速化しています。

- API 料金:極めて競争力のある料金設定。階層型価格体系で最大価格は 1M トークン入出力あたり 4 元(入力)および 16 元(出力、通常価格、現在割引中)。X 付きバージョンは高速バージョンであり性能はほぼ同等です。

- オープンソースライセンス:本シリーズ全て、基礎モデル、ハイブリッド推論モデル、FP8 量子化版を含め、MIT ライセンスで完全にオープン化され、商用利用・改変が無制限に可能です。

- エコシステムサポート:

transformers、vLLM、SGLangなど主流 LLM フレームワークに深く統合され、GitHub や Hugging Face 上でコード、ツールパーサー、推論エンジンを完全に公開し、開発者の展開・微調整・ローカライズを支援します。

6. コア技術革新

GLM-4.5 の性能向上は多数の技術革新に由来します:

- 多 Token 予測 (MTP):推測デコーディング専用層で、CPU および GPU 上の推論速度を大幅に改善。

- 統一アーキテクチャ:推論、エンコーディング、多モーダル感知―行動ワークフローを単一フレームワークに統合。

- 大規模事前学習:最大15 兆トークンのデータセットで事前学習し、強力な一般化能力を獲得。

- RLHF と「Slime」システム:最先端強化学習フレームワーク(Slime)を採用し、同期・非同期訓練混合や混合精度ロールアウトによりエージェントフローを効率的に最適化。

おわりに

Zhipu AI の GLM-4.5 シリーズモデルは性能、効率、オープン性の面で顕著なバランスを実現し、オープンソースコミュニティに強力で使いやすい基盤モデルを提供します。そのハイブリッド推論モードとネイティブエージェント能力は次世代インテリジェントアプリ開発の礎を築きます。包括的なオープンソース化と主要な開発エコシステムのサポートにより、GLM-4.5 シリーズは技術の限界を押し広げ、全世界の開発者と研究者に新たな機会をもたらします。

FAQ

1. GLM-4.5 は先代 GLM-4 モデルと比べて主な改善点は何ですか?

GLM-4.5 はアーキテクチャを MoE にアップグレードし、パラメータ効率を大幅に向上させました。また、ハイブリッド推論モードの導入、ネイティブエージェント機能の統合に加え、推論速度、ツール呼び出し成功率、コンテキストウィンドウ長といった重要指標で大きな改善を達成しています。

2. 個人開発者が GLM-4.5 をローカルで展開できますか?

はい。GLM-4.5-Air バージョンは最適化されており、32〜64GB のメモリを持つ主流消費者向け GPU 上で稼働可能です。公式が全関連コード・モデル重みをオープンソース化し、詳細な展開ドキュメントも提供しています。

3. GLM-4.5 モデルの体験方法は?

ユーザーは公式プラットフォームchat.z.aiでオンライン体験でき、またHugging Faceからモデル重みをダウンロードしてローカル展開が可能です。API サービスも極めて競争力ある価格で提供され、大規模実験に適しています。

4. GLM-4.5 はどのような用途に向いていますか?

本シリーズモデルは多段階推論・計画が必要なエージェントアプリケーション、コード生成・解析、長文要約・問答、複雑なツールチェーンの自動統合に特に適しています。プライベート LLM やエージェントを構築したい企業にとっても理想的な選択肢です。

参考文献

出典について

この記事は merchmindai.net に掲載された内容です。共有または転載する場合は、出典と元記事のリンクを明記してください。

元記事リンク:https://merchmindai.net/blog/ja/post/glm-4-5-overview