Claude Opus 4.7 反応分析: なぜリリース後に評価が二極化したのか

Claude Opus 4.7 は 2026 年 4 月 16 日に公開されました。本記事では Anthropic の公式情報に加え、Reddit と Hacker News の議論をもとに、機能強化の中身と批判、そして評価が割れた理由を整理します。

2026 年 4 月 16 日、Anthropic は Claude Opus 4.7 をリリースしました。公式の位置づけはかなり明確で、「現時点で最も強力な一般提供モデル」として、複雑な推論、長時間にわたるエージェントタスク、知識集約型の作業、視覚理解、記憶能力の強化を前面に出しています。同時に Claude Code、API パラメータ、移行ガイドも更新しており、Opus 4.7 を新しい上位デフォルトモデルとして押し出したい意図がはっきり見えました。

しかし、公開直後のコミュニティ反応は穏やかではありませんでした。特に Claude Code のヘビーユーザー、API ユーザー、Hacker News の開発者の議論では、Opus 4.7 に対してかなりはっきりした賛否の分裂が起きています。実際に強化されたと評価する人がいる一方で、「自信満々に間違えることが増えた」「トークン消費が重い」「調整が前より必要」「実運用では 4.6 より扱いづらい」と感じる人も少なくありませんでした。

本記事は Anthropic の公式リリース、Claude API ドキュメント、そして 2026 年 4 月 18 日時点で確認できる Reddit と Hacker News の議論をもとにしています。コミュニティの声は厳密なベンチマークではありませんが、実際のワークフローの中でモデルがどう体感されるかを知るうえでは非常に参考になります。

背景理解としては、Anthropic が「蒸留攻撃」を名指ししたあと、なぜコミュニティが荒れたのか も参考になります。別ベンダーの新しいコーディングモデルの発表と比較したいなら、GPT-5.3-Codex リリース解説: 機能強化、ベンチマーク結果、導入の考え方 もあわせて読むと流れがつかみやすいはずです。

結論を先に言えば、Claude Opus 4.7 は「全面的な成功」や「明確な失敗」というより、上限は上がった一方で移行コストも大きくなったアップグレード」と見るのが近い と思います。Anthropic と一部のパワーユーザーが見ているのは、長いタスク、複雑な開発作業、画像入力を含むケースでの改善です。一方で別のユーザーが強く感じているのは、より字義通りの挙動、増えたトークン消費、そして実務で出ると厄介な「自信のある誤り」です。

本記事で最も重要なのもこの点です。評価が割れているのは、皆が別々のモデルを見ているからではありません。同じモデルを、異なる種類の仕事に使っていて、しかもデフォルト挙動の変化への許容度が大きく違うからです。

Claude Opus 4.7 では実際に何が変わったのか

公開情報を、実際の体験に影響する変更だけに絞ると、ポイントは大きく 3 つです。

1 つ目は能力の位置づけです。Anthropic は Opus 4.7 を long-horizon agentic work に明確に寄せています。つまり、複数ステップの継続実行、長いコンテキスト内での目標維持、ツールが失敗したあとも前進し続けることを重視しているということです。公式事例やパートナーコメントが「会話がうまい」よりも「タスクを最後まで完了しやすい」に寄っているのは、そのためです。

2 つ目は入力と作業範囲です。API ドキュメントでは、高解像度画像入力に対応した最初の Claude モデルとして説明されており、スクリーンショット理解、ドキュメント認識、コンピュータ操作のようなユースケースを強く意識していることがわかります。言い換えると、Anthropic が今回売りたいのは「より会話が上手い Opus」ではなく、「実際のワークフローに組み込みやすい Opus」です。

3 つ目は、見落とされやすいものの実は最も重要な部分です。デフォルト挙動そのものが変わりました。 今回の更新は能力追加だけではなく、対話の前提も変えています。公式ドキュメントによれば、Opus 4.7 では xhigh effort が追加され、従来の extended thinking budgets は廃止されて adaptive thinking のみになり、thinking summary はデフォルトで非表示になりました。さらに新しい tokenizer により、テキストによってはトークン消費が増える可能性もあります。加えて Anthropic は、低 effort では以前より自動補完的な一般化をせず、指示をより字義通りに実行し、デフォルトではツール呼び出しも控えめになると明記しています。

つまり、多くのユーザーは「モデルを更新しただけ」のつもりでも、実際にはデフォルトの作業スタイル一式を更新していたわけです。この点に気づかないままだと、その後に評価が割れるのはむしろ自然です。

なぜ Anthropic は楽観的なのに、ユーザーは「退化した」と感じるのか

理由は単純で、Anthropic とユーザーが見ている評価軸がそもそも違うからです。

Anthropic の説明は一貫しています。Opus 4.7 は 4.6 よりも、コーディング、長いタスク、視覚理解、記憶、知識作業で強く、パートナーの評価も「より信頼できる」「より完走しやすい」「ツール利用時のミスが少ない」という方向にほぼ揃っています。主要メディアも概ねその枠組みを受け入れましたが、無条件ではありません。たとえば VentureBeat のまとめは象徴的で、Opus 4.7 の強さは認めつつも、「全面圧勝」というよりは「特定の高価値タスクで先頭をわずかに取り返した」という見方をしています。

その一方で、The Verge や Tom's Guide の切り口は別の点を示しています。今回の発表は、単なる性能向上の話ではなく、安全性と製品化のストーリーでもありました。Opus 4.7 は Mythos Preview よりも一般公開に向いたモデルとして配置されており、それはトーン、境界、デフォルト挙動にも自然に影響します。つまり、一部ユーザーが「前より慎重」「少し保守的になった」と感じるのは、単なる気のせいとも言い切れません。

こうした微妙な変化は、開発者の一次観測にも表れています。

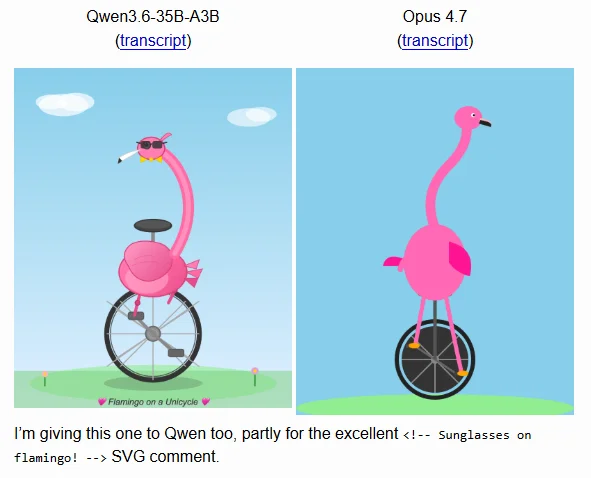

<small>Simon Willison の SVG テスト</small>

<small>Simon Willison の SVG テスト</small>

問題なのは、現場のユーザーはこうした変化をまず製品戦略として理解するわけではないことです。彼らは自分のワークフローの中で「使いやすいかどうか」で受け止めます。そのため、Anthropic が「完了率が上がった」と見ていても、ユーザー側は先に「以前ほど曖昧な指示では動かなくなった」と感じやすいのです。

ネガティブな反応はどこに集中しているのか

Reddit、Hacker News、メディア報道を並べてみると、不満点はかなり似通っています。大きく分けると 4 つです。

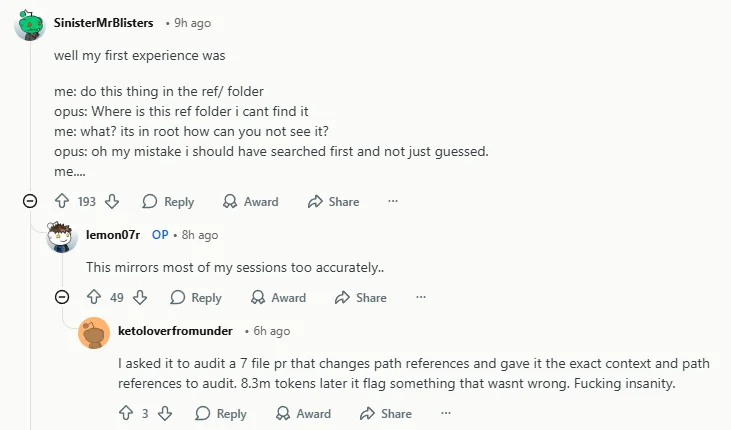

1) 信頼を壊すのは単なるミスではなく、「自信満々の誤り」

Reddit で急速に拡散した投稿が共感を集めたのは、単に「4.7 は賢くない」と言ったからではありません。エンジニアが特に嫌うポイントを突いていたからです。つまり、存在しない前提を勝手に置く、証拠を確認せずに話を進める、訂正されてもなお自分の説明を押し通そうとする、といった挙動です。Business Insider がこの空気を "Claude-lash" と表現したのは象徴的で、すでに一部コミュニティ内の不満を超えて、広い評判の問題になり始めていることを示しています。

ヘビーなコーディング用途では、普通のミス自体は許容されます。ですが、十分に確認していないのに強い確信を見せること は特に致命的です。人間側のレビューコストをそのまま押し上げるからです。

2) 指示の書き方にも、effort 設定にも前より敏感になった

今回の反応でもう 1 つ目立つのは、「4.7 は使えない」のではなく、「4.6 より使い方を選ぶ」という共通認識です。Reddit と Hacker News には、一方で「明らかに退化した」という声があり、他方で「Claude Code や長文脈、high や xhigh effort ではむしろ安定する」という声もあります。この 2 つは実は矛盾していません。むしろ、デフォルト挙動の変化をそのまま反映している可能性があります。

Anthropic のドキュメントにも、この点はかなり明確に書かれています。より literal になり、自動で補ってくれる度合いが下がり、coding や agentic な用途では高い effort が推奨される。つまり、以前は多少曖昧な指示でも進んでいたフローが、今はプロンプトの具体性不足で途中停止しやすくなった、ということです。

3) 能力向上よりコスト増のほうが体感されやすい

新 tokenizer、adaptive thinking、高 effort。このあたりが重なると、ユーザーが真っ先に感じるのは「完了率」よりも、トークン料金、応答の遅さ、やり直し回数です。もし「高くなったぶん、人間の監督が減った」という実感がなければ、4.7 に対する不満はすぐ大きくなります。

だから本当の論点は、「なぜトークンが増えたのか」だけではありません。増えたトークンで、本当に人間の確認作業は減ったのか が問題なのです。

4) モデルの問題と製品の問題が一緒くたに見られている

Hacker News での不満の中には、純粋にモデルだけへの反応ではないものも多くあります。Claude Chat、Claude Code、コネクタ、ホスト環境、CLI、API パラメータ、サブスクリプション体系など、複数のレイヤーが重なった結果として、観測しづらさと一貫性の低下が起きています。ユーザー側から見ると、ある失敗がモデルの質の問題なのか、入力方法の問題なのか、effort 不足なのか、製品側のデフォルト変更なのかを切り分けにくいのです。

原因の切り分けが難しくなると、体感上の摩擦はすべてモデルのせいにされやすくなります。同じバージョンが「より強い」とも「より悪い」とも言われるのは、そのためです。

なぜ今回の論争はここまで増幅されたのか

モデルそのもの以外にも、感情を増幅した背景要因が少なくとも 2 つあります。

第一に、この不満は 4.7 の公開当日に突然始まったわけではありません。 それ以前から VentureBeat、The Register、InfoWorld などは、Claude Code が「前より頭が悪くなった」「nerf されたのではないか」という議論を追っていました。つまり Anthropic は、すでに「性能が戻っているのでは」という不安が存在する空気の中で新モデルを出したことになります。だからユーザーは新しい変化に対して、より敏感に反応しやすかったわけです。

第二に、開発者が Claude に求めているものは、一般的なチャットモデルとは違います。Claude Code のコアユーザーは、単に質問するだけではなく、コードを書き換え、ログを読み、バグを直し、長いタスクチェーンを進めています。そのため、「自分から確認するか」「本当にファイルを最後まで読むか」「間違えたあとにすぐ軌道修正するか」といった点に極端に敏感です。ここがぶれると、普通のチャット製品よりはるかに強い反発が起きます。

だからこそ、Simon Willison のような軽いテストも一定の価値があります。それだけで 4.7 全体が悪いと証明できるわけではありませんが、大きなベンチマークで改善していても、ユーザーが最初に体感しやすい小さなタスクで弱さが見えることは十分あり得る と教えてくれるからです。

では、こうしたネガティブな評価は妥当なのか

私の見方はこうです。妥当ではある。ただし、それをそのまま「Opus 4.7 は失敗だった」とまとめるのは雑すぎる と思います。

妥当だと言える理由は明確です。実際に、リリース直後から退化を強く感じたヘビーユーザーが一定数いました。特に幻覚、自信のある誤り、デフォルト設定の不安定さ、コスト上昇への不満は繰り返し指摘されています。そしてそれは散発的な一例ではなく、Reddit、Hacker News、Business Insider、さらにそれ以前の "nerf" 議論まで含めて、相互に補強し合っています。

一方で、単純に失敗と断じにくい理由もあります。Claude Code、長文脈、長時間タスク、高 effort 設定では、むしろ改善を強く感じたという声も確かに存在するからです。言い換えれば、4.7 はモデルの上限と同時に、うまく使うためのハードルも引き上げたように見えます。ワークフローを再調整する前提なら 4.6 より強い可能性がある一方で、シームレスなアップグレードを期待すると、逆に悪く感じやすいわけです。

アップグレードする価値をどう評価すべきか

もし目的が一時的な話題を追うことではなく、日常のワークフローに入れる価値があるかを見極めることなら、小規模でも比較テストは必要です。

1) 単発の出来ではなく、手戻りコストを見る

多くのモデルは 1 回のデモではよく見えます。しかし実際の生産性を決めるのは、次のような点です。

- 事実確認を自分から行うか

- 指摘後にすぐ修正できるか

- 同じ種類のミスを繰り返すか

- タスク完了までに人間が何回介入する必要があるか

大事なのは「最初の回答が賢そうに見えるか」ではありません。

2) デフォルト設定と高 effort を分けて測る

4.7 は effort 設定によって挙動がかなり変わるため、少なくともデフォルト、high、xhigh の 3 パターンは分けて比較したほうがよいでしょう。そうしないと、「設定の問題」を「モデル全体の退化」と誤認したり、「高コスト設定でのみ得られる改善」を「常に良い」と勘違いしたりしやすくなります。

3) トークンと遅延を独立して記録する

Opus 4.7 をめぐる議論のかなりの部分は、コストの体感にあります。タスクの成功・失敗だけを見て、トークン数、レイテンシ、手戻り回数を見なければ、チームにとって意味のある評価は出しにくいはずです。

4) まだ 4.6 時代の使い方を引きずっていないか確認する

以前の Claude に「意図を汲んで補完してもらう」使い方をしていたなら、今はその前提を見直したほうがいいかもしれません。4.7 がより literal で抑制的になっているなら、「先にどのファイルを確認するか」「結論の前に検証すること」「欠けている設定を勝手に補わないこと」といった指示を、前より明示する必要があります。

これは確かに使いこなしのハードルを上げますが、現行バージョンではそれが現実的な前提なのだと思います。

まとめ

Claude Opus 4.7 のリリースは、単なる「パラメータが大きくなった」「スコアが上がった」という更新ではありませんでした。むしろ、エージェント型ワークフローに向けた再設計という性格が強いアップデートです。Anthropic が強調しているのは、長いタスクへの強さ、信頼性、画像理解、記憶、そしてエンジニアリング系エージェントへの適性です。

ただし、公開後のコミュニティ反応は別の面をはっきり示しています。モデルのデフォルト、tokenizer、thinking モード、可視性、製品設定が一度に変わると、客観的な能力が上がっていたとしても、ユーザーは最初に摩擦の増加、制御性の低下、不信感の強まりを感じることがあります。

その意味で、現時点での Opus 4.7 のより正確な評価は、「傑作」でも「大失敗」でもなく、上限は高いが、デフォルトのままだと環境や使い方を選ぶ新バージョン という表現に近いでしょう。ワークフローを再調整する気があるなら 4.6 より強い可能性がありますし、無段差の移行を期待するなら、かなり大きな落差として感じるかもしれません。

だからこそ、今回のネガティブな声には意味があります。単なる感情的な反発ではなく、最先端モデルのリリースでは、ベンチマークや提携先コメントだけでなく、移行コスト、デフォルト設定、ユーザーが状態を観測しやすいことまで含めて設計しなければならない という重要な示唆になっているからです。

関連リソース

- Anthropic 公式発表: Introducing Claude Opus 4.7

- Claude API Docs: What's new in Claude Opus 4.7

- Claude API Docs: Migration guide

- Reddit: Opus 4.7 is legendarily bad. I cannot believe this.

- Hacker News: Claude Opus 4.7(id=47793411)

- Business Insider: The Claude-lash is here: Opus 4.7 is burning through tokens and some people's patience

- VentureBeat: Anthropic releases Claude Opus 4.7, narrowly retaking lead for most powerful generally available LLM

- The Verge: Anthropic releases a new Opus model amid Mythos Preview buzz

- Tom's Guide: Anthropic just released Opus 4.7 — the 'civilian' version of the AI they said was too dangerous for us

- Simon Willison: Qwen3.6-35B-A3B on my laptop drew me a better pelican than Claude Opus 4.7

- VentureBeat: Is Anthropic 'nerfing' Claude? Users increasingly report performance degradation as leaders push back

- The Register: AMD's AI director slams Claude Code for becoming dumber and lazier since last update

出典について

この記事は merchmindai.net に掲載された内容です。共有または転載する場合は、出典と元記事のリンクを明記してください。

元記事リンク:https://merchmindai.net/blog/ja/post/claude-opus-4-7-feedback-analysis